#ColoniaCaroya : Puesta en valor del algarrobo centenario...

El árbol está ubicado en unespacio que, desde hace tiempo es resguardado por los...

#JesusMaria : Estrenos de cine para la última semana de...

Este jueves llegan dos peículas geniales a la pantalla grande de nuestra región.

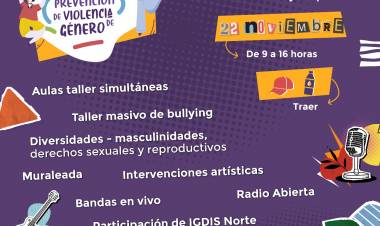

#Sinsacate : Eventos especiales por el Día Internacional...

La Municipalidad de Sinsacate está dedicada a resaltar la importancia de la danza...

#JesusMaria : Actividad por el Día de la Cultura Afrocordobesa

Será el sábado 27 de abril en el Museo Jesuítico Nacional

#JesusMaria : Agenda de actividades por el Día del Animal

Jornadas de castración masiva, vacunación antirrábica y visitas en el Refugio Canino...

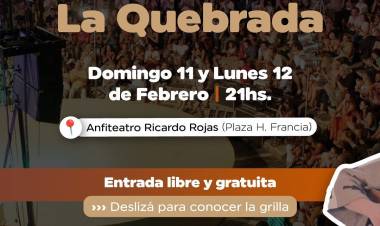

#RIOCEBALLOS : Segunda jornada de Festival de la Quebrada

Con entrada libre y gratuita en el Anfiteatro Ricardo Rojas

#SANTAMARIA : Cosquín Rock 2024

El encuentro más esperado del año ya tiene fecha y lugar! Se realizará los días...

#EstacionGeneralPaz : Primer Festival Raíces, para unirnos...

Hoy 25 de noviembre se realizará el primer “Festival Raíces” en Estación General...

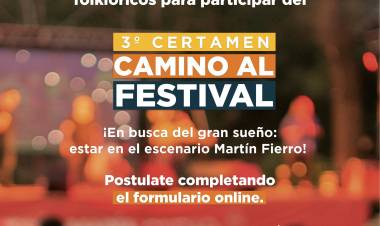

#JesusMaria : Se viene la tercera edición del Certamen...

Los grupos, bandas, solistas y ballets que estén interesados en participar se deben...

#JesusMaria : Estrenos de cine para la última semana de...

Este jueves llegan dos peículas geniales a la pantalla grande de nuestra región.

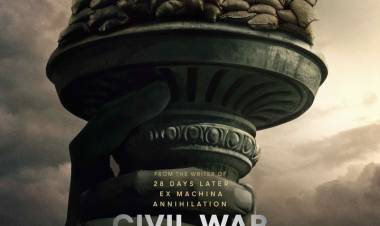

#JesusMaria : Grandes estrenos en el cine

Esta semana se renueva la cartelera con dos geniales producciones.

#JesusMaria : Estreno de la semana en el cine

La cartelera del cine local se renueva con un thriller muy interesante.

#Córdoba : Animación cordobesa seleccionada por un prestigioso...

La serie de animación cordobesa “Yo te adopto” fue seleccionada para participar...

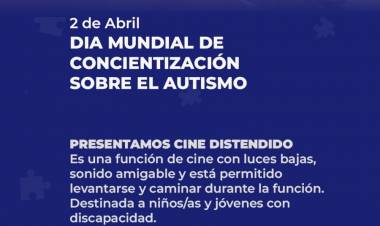

#ColoniaCaroya : Cine distendido por el Día de Concientización...

Se realizará una función especial en la Casa de la Historia y la Cultura del Bicentenario...

#JesusMaria : Primeros estrenos de abril en el cine

Este jueves se renueva la cartelera del cine local y llegan dos películas con historias...

#JesusMaria :Presentación del libro “Rally de Argentina,...

La obra comprende la historia y el presente de la carrera en la provincia de Córdoba....

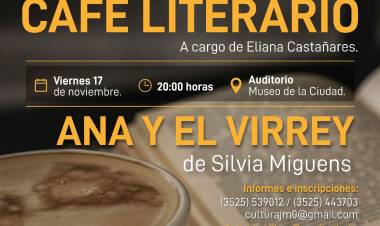

#JesusMaria : Último café literario del año.

El viernes 17 de noviembre, desde las 20 horas, se compartirá un momento de encuentro,...

#JesusMaria : Aldo Alemán dejó un nuevo legado literario:...

En el marco del 150º aniversario de la ciudad, el escritor y poeta local presentó...

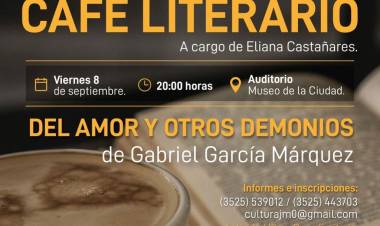

#JesusMaria : Nueva noche de Café Literario

El Museo de la Ciudad será escenario de una nueva noche de Café Literario

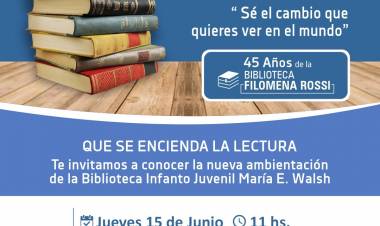

#ColoniaCaroya : Día del Libro en la Biblioteca Filomena...

Habrá una linda actividad el juevbes 15 de junio desde las 11 hs.

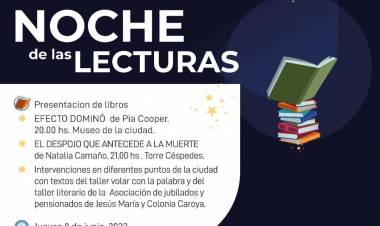

#JesusMaria : Se suma a "La Noche de las lecturas" con...

La ciudad propone una grilla de actividades este jueves 8 de junio, en adhesión...

#Sinsacate : 24 de septiembre, día de la Virgen de la Merced...

Entre los actos religiosos más importantes de nuestra zona se encuentra la peregrinación...

#Sinsacate : Fiesta Patronal en honor a SAN ISIDRO LABRADOR

Como cada año Sinsacate rinde homenaje a su patrono San Isidro Labrador, protector...

#Sinsacate : En Semana Santa se recreará el tradicional...

El Viernes Santo, una vez más, se llevará a cabo este evento que convoca a la comunidad...

COLONIA CAROYA: MULTITUDINARIA FOGATA DE SAN PEDRO Y SAN...

El Parque “Bernardo Hughes” recibió a unas dos mil personas.

COLONIA CAROYA: ESPERANDO EL RITUAL DEL “PIGNARÛL”

El próximo miércoles 29 de junio se volverá a encender la Fogata de San Pedro y...

COLONIA CAROYA: ¡LA PRESENCIALIDAD VUELVE AL “PIGNARÛL”!

Después de dos años con modalidad virtual, vuelve la presencialidad a esta fiesta...

#JesusMaria : Las Copas del Mundo, Finalissima y América,...

Para celebrar y sentirse más campeones del mundo que nunca, la ciudad recibirá a...

#JesusMaria : Con una ceremonia a pura emoción cerró el...

El centro de la ciudad se colmó de fanáticos para disfrutar de la rampa de premiación,...

#JesusMaria : Operativo de tránsito por el Rally

Desde el jueves 11 de abril a las 12 horas, y hasta el domingo 14 por la noche,...

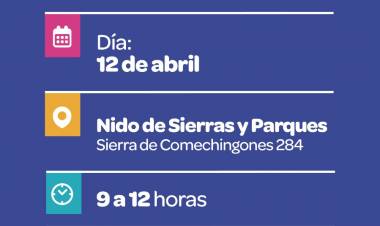

#JesusMaria : Cronograma de actividades para el fin de...

Del 12 al 14 de abril la región será escenario de variadas propuestas en torno al...

#JesusMaria : Registro de alojamientos habilitado por el...

La Municipalidad recomienda consultar los alojamientos registrados por la Dirección...

JESÚS MARÍA: ACÁ TE DEJAMOS LAS PROPUESTAS PARA ESTE FINDE

Café literario, exposiciones de arte, conciertos musicales y expo vinos, forman...

COOPERATIVA: BONIFICARAN A USUARIOS POR LA CAIDA DE LOS...

La Cooperativa de Servicios Públicos, informa, que se realizará una bonificación...

IPTV: SE REGISTRAN INCONVENIENTES CON LOS SERVICIOS TICS

La Cooperativa de Servicios Públicos informa que, como lo anticipamos más temprano,...

#JesusMaria : 49 artistas participaron del 19º Encuentro...

Durante dos jornadas la ciudad fue epicentro de uno de los eventos culturales más...

#JesusMaria : Convocatoria a artistas para el 19º Encuentro...

El 19 y 20 de abril, la ciudad será escenario del prestigioso evento artístico que...

#JesusMaria : Se inaugura la muestra "Vibraciones” de Belén...

La apertura será el viernes 12 de abril a las 20:30 horas. Una experiencia para...

#JesusMaria : Nueva muestra de arte, "El paisaje como lenguaje"

La exposición de la artista Virginia Saint Bonnet se presentará este viernes 20...

#JesusMaria : La Torre Céspedes abre sus puertas a una...

En el mes aniversario de Jesús María, se habilitará este viernes 22 de septiembre,...

#JesusMaria : Inauguración de la exposición "Ecos de Persistencia".

Será en la Estancia de Jesús María, el jueves 21 de septiembre a las 19 hs.

#Córdoba : Cultura de la provincia presente en la Feria...

Editoriales y artistas cordobeses participarán de la 48° edición de la Feria Internacional...

#JesusMaria : Manga, animé y cultura pop en una nueva edición...

Se realizará el 6 y 7 de abril, en la Explanada del Ferrocarril. El evento reunirá...

#Córdoba : Llega la 41° Feria Internacional de Artesanías

Un lugar donde se conjugan la labor experta de artesanos de técnicas muy variadas,...

#JesusMaria : El Patio de Doña Pipa será escenario de la...

Una jornada para disfrutar en familia con diferentes atracciones: caravana de motos...

#ColoniaCaroya : Primera feria agroecológica

Este sábado 14 de octubre, desde las 15:30, se realizará la primera Feria Agroecológica...

#Sinsacate : Eventos especiales por el Día Internacional...

La Municipalidad de Sinsacate está dedicada a resaltar la importancia de la danza...

#JesusMaria : Agenda de actividades por el Día del Animal

Jornadas de castración masiva, vacunación antirrábica y visitas en el Refugio Canino...

#Córdoba : El Teatro San Martin celebra su 133° aniversario

Por tal motivo, se llevará adelante una serie de conciertos con entrada gratuita.

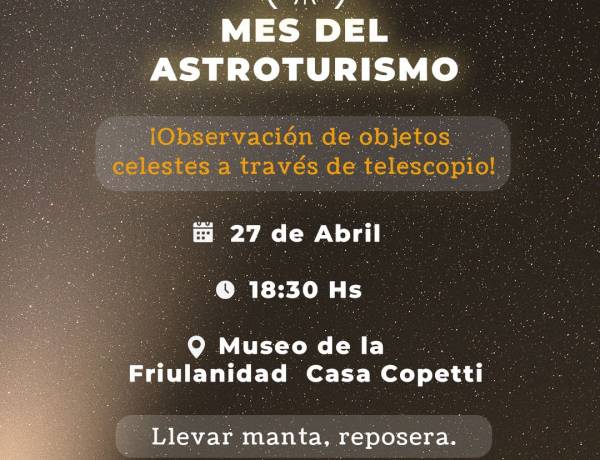

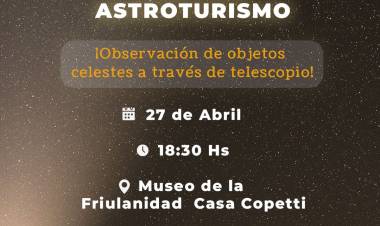

#JesusMaria : Actividades en el marco del Mes del Astroturismo

El Parque del Oeste será epicentro del Astroturismo Cultural y la Caminata nocturna...